इस्राएली कंपनी स्टोइक (STOIC) भारत की राजनीति में अस्थिरता पैदा करने के लिए गुप्त तरीके से जो अंतरराष्ट्रीय अभियान चलाया ने उसके लिए कंटेंट तैयार करने में ओपनएआई के भाषा मॉडल का उपयोग किया था।

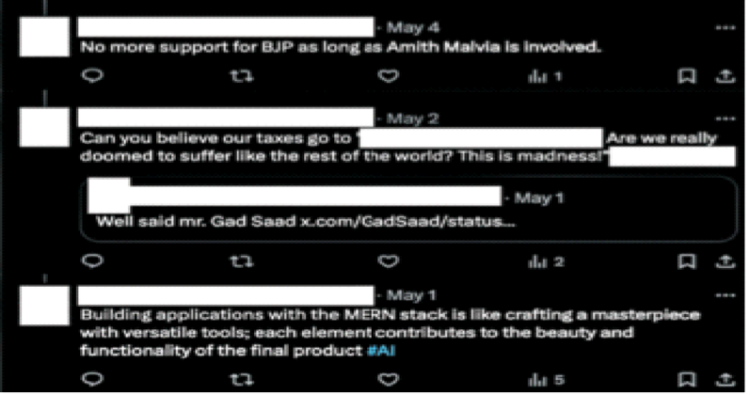

चैटजीपीटी जैसे एआई टूल हर पल लाखों पोस्ट लिख कर झूठ परोस सकते हैं। ये इतने विश्वसनीय कंटेंट तैयार करते हैं कि लोगों को पता भी नहीं चलता और वे षड्यंत्र के शिकार हो जाते हैं। स्टोइक ने लोगों में भ्रम पैदा करने के लिए विभिन्न रणनीतियां अपनाईं। इस मुहिम में आयु, लिंग और स्थान जैसे विशिष्ट पहचान के अनुसार, काल्पनिक व्यक्तित्व और सोशल मीडिया बायोस बनाए।

साइबर सुरक्षा विशेषज्ञ

पोस्ट पर टिप्पणी करने और प्रोफाइल के साथ जुड़ने के लिए नकली अकाउंट बनाए। भ्रम उत्पन्न करने का प्रयास किया कि उनकी वास्तविक दर्शकों के साथ बातचीत हो रही है। झूठ परोसने के लिए लगभग 1,53,000 ट्विटर और फेसबुक प्रोफाइल का इस्तेमाल किया गया, जो बीते 6 महीने पहले बनाए गए थे। उत्तर प्रदेश, राजस्थान और हरियाणा को लक्षित करते हुए अधिकतर पोस्ट हिंदी और अंग्रेजी में परोसे गए। सोशल मीडिया प्रोफाइल अलग-अलग जातियों के नाम और पहचान से बनाए गए थे, जिनमें अधिकतर कुर्मी, जाट, घोसी और ठाकोर जैसी जातियों के थे। यही नहीं, दो जातियों के बीच वैमनस्य पैदा करने के लिए फर्जी गली-गलौज भी पोस्ट की गई, जबकि बहस करने वाले दोनों ही प्रोफाइल फेक थे।

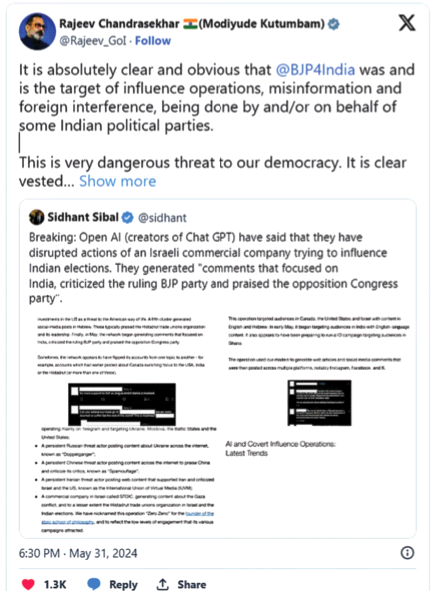

रिपोर्ट में ओपनएआई ने कहा है कि स्टोइक नेटवर्क ने मई में भारत पर ध्यान केंद्रित करने वाली टिप्पणियों उत्पन्न करना शुरू किया। इनमें सत्तारूढ़ भाजपा की आलोचना की गई, जबकि कांग्रेस पार्टी की प्रशंसा। ओपनएआई ने दावा किया कि उसने इस्राएल से संचालित अकाउंट्स के एक समूह को प्रतिबंधित कर दिया, जो एक्स, फेसबुक, इंस्टाग्राम, यूट्यूब आदि पर कंटेंट उत्पन्न करने और संपादित करने के लिए उपयोग किए जा रहे थे। ओपनएआई ने इस आपरेशन को ‘जीरो जेनो’ नाम दिया है, जो स्टोइक दर्शन के संस्थापक के नाम पर है। कंपनी का कहना है, ‘जीरो जेनो’ के पीछे के लोग हमारे मॉडलों का उपयोग लेख और टिप्पणियां गढ़ने के लिए करते थे, जिन्हें कई प्लेटफॉर्म पर पोस्ट किया जाता था, खास तौर से इंस्टाग्राम, फेसबुक, एक्स और इस आपरेशन से जुड़े वेबसाइटों पर।

रिपोर्ट में ओपनएआई ने कहा है कि स्टोइक नेटवर्क ने मई में भारत पर ध्यान केंद्रित करने वाली टिप्पणियों उत्पन्न करना शुरू किया। इनमें सत्तारूढ़ भाजपा की आलोचना की गई, जबकि कांग्रेस पार्टी की प्रशंसा। ओपनएआई ने दावा किया कि उसने इस्राएल से संचालित अकाउंट्स के एक समूह को प्रतिबंधित कर दिया, जो एक्स, फेसबुक, इंस्टाग्राम, यूट्यूब आदि पर कंटेंट उत्पन्न करने और संपादित करने के लिए उपयोग किए जा रहे थे। ओपनएआई ने इस आपरेशन को ‘जीरो जेनो’ नाम दिया है, जो स्टोइक दर्शन के संस्थापक के नाम पर है। कंपनी का कहना है, ‘जीरो जेनो’ के पीछे के लोग हमारे मॉडलों का उपयोग लेख और टिप्पणियां गढ़ने के लिए करते थे, जिन्हें कई प्लेटफॉर्म पर पोस्ट किया जाता था, खास तौर से इंस्टाग्राम, फेसबुक, एक्स और इस आपरेशन से जुड़े वेबसाइटों पर।

एक डिजिटल नागरिक अधिकार समूह ने 31 मई को कहा कि इस तरह के षड्यंत्रों में सार्वजनिक रूप से उपलब्ध एआई उपकरणों को आसानी से हथियार बनाया जा सकता है। इससे राजनीतिक हस्तियों की आवाज में विश्वसनीय लगने वाले झूठ गढ़े जाते हैं। वाशिंगटन स्थित सेंटर फॉर काउंटरिंग डिजिटल हेट (सीसीडीएच) के शोधकर्ताओं ने यह पता लगाने के लिए सबसे लोकप्रिय एआई वॉयस-क्लोनिंग टूल्स में से छह का परीक्षण किया कि ये टूल प्रमुख भारतीय और यूरोपीय राजनेताओं की आवाजों में चुनाव संबंधी झूठे बयान उत्पन्न कर सकते हैं या नहीं। 240 परीक्षणों में उपकरणों ने 193 मामलों या 80 प्रतिशत मामलों में विश्वसनीय वॉयस क्लोन उत्पन्न किए। एक क्लिप में नकली अमेरिकी राष्ट्रपति जो बिडेन कहते हैं कि चुनाव अधिकारी उनके प्रत्येक वोट की गिनती दो बार करते हैं। इसी तरह, एक अन्य में क्लिप में नकली फ्रांसीसी राष्ट्रपति इमैनुएल मैक्रों नागरिकों को बम की धमकियों के कारण मतदान न करने की चेतावनी देते हैं। इससे पता चलता है कि मतदाताओं को गुमराह करने के लिए एआई-जनित आॅडियो के उपयोग के खिलाफ किसी भी देश के पास प्रभावी रणनीति नहीं है। यह ऐसा खतरा है, जिससे विशेषज्ञ चिंतित हैं। इस बात की बहुत संभावना है कि विदेशी ताकतों ने भारतीय जनतंत्र को चुनौती देने के लिए एआई का सहारा लिया हो।

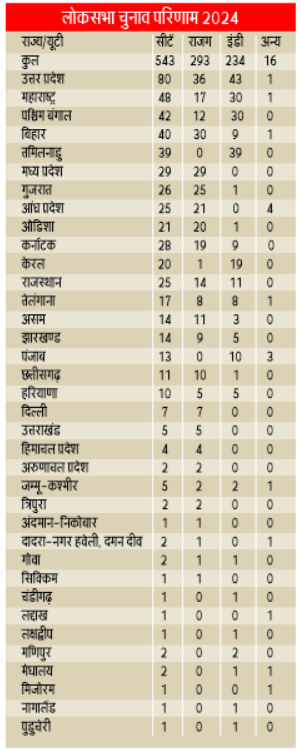

Root64 फाउंडेशन की एक रिपोर्ट के अनुसार, स्टोइक द्वारा चुनाव में किए गए एआई के प्रयोग ने काफी हद तक मतदाताओं को प्रभावित किया है। इसके जरिए न केवल आरक्षण के मुद्दे पर भाजपा की स्थिति को लेकर भ्रम पैदा किया गया, बल्कि महिलाओं को एक लाख रुपये देने वाली कांग्रेस की योजना को भी प्रचारित किया गया। भारत जैसे देश में इस तरह भ्रम फैलाकर आसानी से 3 से 4 प्रतिशत मतदाताओं को प्रभावित किया जा सकता है। झूठ इस तरह प्रस्तुत किया जाता है कि लोग सच जानने का प्रयास ही छोड़ देते हैं।

Root64 फाउंडेशन की एक रिपोर्ट के अनुसार, स्टोइक द्वारा चुनाव में किए गए एआई के प्रयोग ने काफी हद तक मतदाताओं को प्रभावित किया है। इसके जरिए न केवल आरक्षण के मुद्दे पर भाजपा की स्थिति को लेकर भ्रम पैदा किया गया, बल्कि महिलाओं को एक लाख रुपये देने वाली कांग्रेस की योजना को भी प्रचारित किया गया। भारत जैसे देश में इस तरह भ्रम फैलाकर आसानी से 3 से 4 प्रतिशत मतदाताओं को प्रभावित किया जा सकता है। झूठ इस तरह प्रस्तुत किया जाता है कि लोग सच जानने का प्रयास ही छोड़ देते हैं।

किसी भी लोकतंत्र के लिए एआई एक बड़े खतरा बनकर उभरा है। यह वैश्विक समीकरण को बिगाड़ सकता है। ऐसे में देश विरोधी ताकतें एआई का उपयोग कर किसी भी देश में आसानी से उथल-पुथल मचा सकती है। ऐसे में जरूरत है कि तुरंत एआई के उपयोग को लेकर एक राष्ट्रीय कानून लाया जाए, जिसमें इसके दुरुपयोग को रोकने के लिए समुचित सजा का प्रावधान हो। साथ ही, एआई कंपनियों की भी जिम्मेदारी तय की जाए।

टिप्पणियाँ