स्टार बल्लेबाज विराट कोहली का वायरल हुआ 33 सैकेंड का एक डीपफेक वीडियो इन दिनों काफी चर्चा में है, जिसमें वे सचिन तेंदुलकर और स्वयं को ‘लीजेंड’ बताते हुए भारतीय क्रिकेट टीम के ओपनर शुभमन गिल की बुराई करते नजर आ रहे हैं। यह डीपफेक वीडियो विराट के एक पुराने इंटरव्यू को एडिट करते हुए बनाया गया, जिसमें कोहली कहते दिख रहे हैं, ‘मैं गिल को करीब से देख रहा हूं, वे प्रतिभाशाली हैं, इसमें कोई संदेह नहीं है लेकिन प्रतिभा दिखाने और स्टार बनने के बीच एक बड़ा अंतर है। गिल की टैक्नीक शानदार है लेकिन हमें खुद से आगे नहीं बढ़ना चाहिए। लोग उसे अगले विराट कोहली के तौर पर देखते हैं लेकिन मैं क्लीयर कर दूं कि केवल एक ही विराट कोहली है। मैंने जितने खतरनाक गेंदबाजों का सामना किया है और जिन परिस्थितियों में रन बनाए हैं, उसे आप गिल की एक पारी से नहीं आंक सकते।’

तेंदुलकर भी हो चुके हैं डीपफेक के शिकार

यह पहला मौका नहीं है, जब विराट डीपफेक के शिकार हुए हों, इसी साल फरवरी महीने में भी उनका एक ऐसा डीपफेक वीडियो वायरल हुआ था, जिसमें वह एक सट्टेबाजी ऐप का विज्ञापन करते दिखाई दिए थे और तब विराट को सोशल पोस्ट के जरिये उसे लेकर सफाई भी देनी पड़ी थी। विराट कोहली से पहले कई और सेलिब्रिटी भी ऐसे ही डीपफेक के शिकार हो चुके हैं, जिनमें प्रमुख नाम सचिन तेंदुलकर का भी शामिल हैं। जनवरी 2024 में तेंदुलकर ने स्वयं प्रौद्योगिकी के व्यापक दुरुपयोग पर निराशा व्यक्त करते हुए ‘एक्स’ पर खुलासा किया था कि उनकी तस्वीर के साथ एक मोबाइल एप्लिकेशन को बढ़ावा देने वाला एक डीपफेक वीडियो सोशल मीडिया पर घूम रहा है, जो फर्जी है। उस फर्जी वीडियो में सचिन ‘स्काईवर्ड एविएटर क्वेस्ट’ गेमिंग ऐप को प्रमोट करते नजर आए थे। फेक वीडियो में वह कहते दिखे थे कि मेरी बेटी सारा इस गेम से रोजाना बहुत पैसा निकालती है और मुझे आश्चर्य होता है कि अब अच्छा-खासा पैसा कमाना कितना आसान हो गया है। वीडियो वायरल होने के बाद सचिन ने केंद्रीय सूचना एवं प्रसारण राज्यमंत्री और महाराष्ट्र साइबर पुलिस को टैग कर लोगों को सचेत करते हुए लिखा था कि वीडियो नकली है और आपको धोखा देने के लिए बनाया गया है।

प्रधानमंत्री और राष्ट्रपति जता चुके हैं चिंता

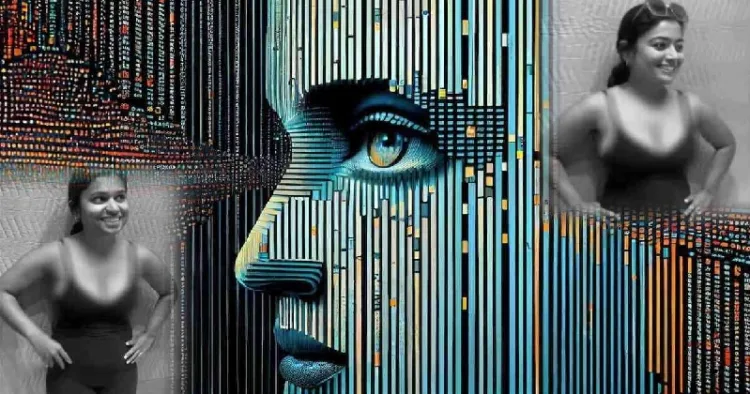

भारत में डीपफेक मुद्दे पर आक्रोश पहली बार तब उभरा था, जब डीपफेक तकनीक के जरिये तैयार किया गया एक ऐसा वीडियो वायरल हुआ था, जिसमें नजर आ रही एक महिला को ‘पुष्पा’ जैसी सफल फिल्म से प्रसिद्ध हुई अभिनेत्री रश्मिका मंदाना दिखाने का प्रयास किया गया था। तब अमिताभ बच्चन ने उस वीडियो का संदर्भ देते हुए सोशल मीडिया प्लेटफॉर्म पर लिखा था कि इस मामले में कानूनी कार्रवाई होनी चाहिए। रश्मिका के बाद बॉलीवुड अभिनेत्री कैटरीना कैफ, काजोल, रवीना टंडन इत्यादि के डीपफेक वीडियो भी सामने आए। बॉलीवुड अभिनेता शाहरूख खान और सलमान खान के डीपफेक वीडियो भी खूब वायरल हुए थे, जिनमें उन्हें बेहद मोटा दर्शाया गया था। डीपफेक मुद्दे को लेकर आक्रोश तब और ज्यादा बढ़ गया था, जब कुछ प्रसिद्ध फिल्म अभिनेताओं और अभिनेत्रियों के डीपफेक वीडियो सामने आने के बाद प्रधानमंत्री नरेंद्र मोदी का भी एक ऐसा वीडियो वायरल हुआ था, जिसमें उन्हें गरबा खेलते दिखाया गया था जबकि स्वयं प्रधानमंत्री के मुताबिक उन्होंने कभी गरबा खेला ही नहीं। प्रधानमंत्री का वह फर्जी वीडियो वायरल होने के बाद से ही ‘डीपफेक’ एक बड़ा राष्ट्रीय मुद्दा बना हुआ है और इस पर नकेल कसने की मांग निरंतर उठ रही है। प्रधानमंत्री और राष्ट्रपति भी ऐसे फेक वीडियो को लेकर कई बार चिंता जाहिर कर चुके हैं। डीपफेक के खतरों को लेकर प्रधानमंत्री चेताते हुए कह चुके हैं कि एआई द्वारा बनाए गए डीपफेक बड़े संकट का कारण बन सकते हैं, जो समाज में असंतोष भी पैदा कर सकते हैं। इसीलिए वह मीडिया से इसके दुरुपयोग के बारे में जागरूकता बढ़ाने और लोगों को शिक्षित करने का आग्रह भी करते रहे हैं। राष्ट्रपति द्रौपदी मुर्मू भी अपराधियों द्वारा जेनरेटिव आर्टिफिशियल इंटेलीजेंस के इस्तेमाल तथा डीपफेक को लेकर चिंता जाहिर करते हुए कह चुकी हैं कि पुलिस अधिकारियों को सदैव नई तकनीक से अपडेट रहना होगा ताकि अपराधियों पर बढ़त ली जा सके।

तकनीक ही हो सकती है ‘डीपफेक’ की काट

यह वाकई बेहद चिंताजनक स्थिति है कि कृत्रिम मेधा यानी आर्टिफिशियल इंटेलीजेंस (एआई) की मदद से तैयार किए जा रहे डीपफेक वीडियो अब न केवल जानी-मानी हस्तियों बल्कि आम आदमी के भी गले की फांस बनते जा रहे हैं। देश में डीपफेक तकनीक के संभावित दुरुपयोग और इसके गैर-नियमन के खिलाफ दो याचिकाओं पर सुनवाई करते हुए हाल ही में दिल्ली हाईकोर्ट ने भी कहा है कि डीपफेक तकनीक समाज में एक गंभीर खतरा बनने जा रही है और केवल तकनीक ही ‘एआई’ की काट हो सकती है। डीपफेक के बारे में कार्यवाहक चीफ जस्टिस मनमोहन का कहना था, ‘‘यह ऐसा कुछ है कि आप जो देख रहे हैं और जो सुन रहे हैं, आप उस पर भरोसा नहीं कर सकते। यह कुछ ऐसा है, जो चकित करता है। जो मैंने अपनी आंखों से देखा और जो मैंने अपने कानों से सुना, मुझे उस पर भरोसा नहीं करना है, यह बहुत ही चौंकाने वाला है।”

‘डीपफेक’ आखिर है क्या?

‘डीपफेक’ शब्द वास्तव में ‘डीप लर्निंग’ और ‘फेक’ के मेल से बना है। डीपफेक छवियों अथवा रिकॉर्डिंग को बदलकर और हेर-फेर करके बनाए जाते हैं ताकि किसी व्यक्ति को गलत तरीके से ऐसा कुछ करते या कहते हुए दिखाया जा सके, जो उसने किया ही नहीं या कहा ही नहीं। किसी भी वीडियो में किसी व्यक्ति के चेहरे अथवा शरीर को डिजिटल रूप से बदलने को ही ‘डीपफेक’ कहते हैं, जो वीडियो और ऑडियो दोनों ही रूप में हो सकता है। इसे एक स्पेशल मशीन लर्निंग का इस्तेमाल करके बनाया जाता है, जिसे ‘डीप लर्निंग’ कहा जाता है। डीप लर्निंग में कम्प्यूटर को दो वीडियो या फोटो दिए जाते हैं, जिन्हें देखकर वह स्वयं ही दोनों वीडियो या फोटो को एक जैसा बनाता है यानी एडिटेड वीडियो में किसी अन्य के चेहरे को किसी अन्य के चेहरे से बदल दिया जाता है। इस तरह के फोटो तथा वीडियो में कुछ छिपी हुई लेयर्स होती हैं, जिन्हें केवल एडिटिंग सॉफ्टवेयर की मदद से ही देखा जा सकता है। ये वीडियो इतने सटीक होते हैं कि आप इन्हें आसानी से नहीं पहचान सकते। यही कारण है कि डीपफेक फोटो और वीडियो फेक होते हुए भी असली नजर आते हैं। एआई की मदद से बने ऐसे वीडियो किसी को भी आसानी से धोखा देने में पूरी तरह सक्षम होते हैं। डीपफेक में कृत्रिम मेधा और आधुनिक तकनीकों का इस्तेमाल करते हुए किसी वीडियो क्लिप अथवा फोटो पर किसी अन्य व्यक्ति का चेहरा लगाने या आवाज बदलने का चलन तेजी से बढ़ रहा है। इसके जरिये कृत्रिम तरीके से ऐसे क्लिप या फोटो विकसित किए जा रहे हैं, जो देखने में वास्तविक लगते हैं। डीपफेक के लिए इन दिनों कई वेबसाइट और एप हैं, जहां लोग ऐसे वीडियो बना रहे हैं।

कैसे तैयार किए जाते हैं डीपफेक कंटेट?

डीपफेक कंटेंट एक-दूसरे के साथ प्रतिस्पर्धा करते दो एल्गोरिदम (डिकोडर और एनकोडर) का उपयोग करके तैयार किए जाते हैं। इस बेहद पेचीदा तकनीक में फेक डिजिटल कंटेंट बनाकर डिकोडर के जरिये यह पता लगाया जाता है कि कंटेंट असली है या नकली। डिकोडर हर बार कंटेंट को असली अथवा नकली के रूप में सही ढ़ंग से पहचानता है और फिर उस जानकारी को एनकोडर को भेज देता है ताकि अगले डीपफेक में गलतियां सुधारकर उसे और बेहतर किया जा सके। उसके बाद जो फाइनल आउटपुट निकलता है, वह बिल्कुल असली जैसा होता है लेकिन वास्तव में वह फेक होता है। यह तकनीक जनरेटिव एडवर्सरियल नेटवर्क (जीएएन) का इस्तेमाल करती है, जिससे फेक वीडियो और फोटो बनाए जाते हैं। सोशल मीडिया प्लेटफॉर्म पर डीपफेक वीडियो डाले जाने के बाद ये बहुत तेज गति से फैलते हैं। विभिन्न रिपोर्टों के मुताबिक इंटरनेट पर इस समय करोड़ों डीपफेक वीडियो मौजूद हैं। हालांकि इस तकनीक का इस्तेमाल मनोरंजन के लिए भी किया जाता है लेकिन पोर्नोग्राफी में इस तकनीक का काफी इस्तेमाल होता है। डीपफेक के जरिये ही किसी फिल्म अभिनेता अथवा अभिनेत्री का चेहरा बदलकर पोर्न साइटों पर अश्लील कंटेंट पोस्ट किया जाता है। माना जाता है कि इस तकनीक की शुरुआत ही अश्लील कंटेंट बनाने से हुई थी। ‘डीपट्रेस’ की एक रिपोर्ट के मुताबिक 2019 में ऑनलाइन पाए गए डीपफेक वीडियो में करीब 96 फीसद अश्लील कंटेंट ही था।

डीपफेक तकनीक का इतिहास

डीपफेक तकनीक का इतिहास देखें तो पहली बार 2014 में इयन गुडफ्लो और उनकी टीम ने इस तकनीक को विकसित किया था, जिसमें धीरे-धीरे नई-नई तकनीकों के साथ नए-नए परिवर्तन किए जाते रहे। वैसे 1997 में भी क्रिस्टोफ ब्रेगलर, मिशेल कोवेल और मैल्कम स्लेनी ने भी डीपफेक तकनीक की मदद से एक वीडियो में विजुअल से छेड़छाड़ की थी और एंकर द्वारा बोले जा रहे शब्दों को बदल दिया था लेकिन उसे एक प्रयोग के तौर पर किया गया था। हालांकि इस तकनीक का इस्तेमाल हॉलीवुड फिल्मों में बड़े पैमाने पर किया जाता रहा है। दरअसल शूटिंग के दौरान कई बार किसी कलाकार के पास डेट्स की कमी होने या शूटिंग के बीच में ही किसी कलाकार की मौत हो जाने पर इस तकनीक का इस्तेमाल किया जाता था लेकिन तब इस तकनीक का इस्तेमाल नकारात्मक तरीके से नहीं होता था लेकिन जैसे-जैसे यह तकनीक परिष्कृत होती गई, असली-नकली का फर्क करना भी मुश्किल होने लगा और कुछ लोग इसका गलत इस्तेमाल करने लगे। इसी परिष्कृत तकनीक के जरिये विभिन्न हॉलीवुड और बॉलीवुड अभिनेत्रियों के पोर्न वीडियो बनाए जाने लगे। अनेक पोर्न वेबसाइट ऐसे डीपफेक वीडियो से भरी पड़ी हैं। पहली बार डीपफेक शब्द 2017 के अंत में एक ‘रेडिट’ उपयोगकर्ता द्वारा बनाया गया था, जिसने अश्लील वीडियो पर विख्यात हस्तियों के चेहरे को सुपरइम्पोज करने के लिए डीप लर्निंग तकनीक का इस्तेमाल किया था। 2018 तक ओपन-सोर्स लाइब्रेरी तथा ऑनलाइन शेयर किए गए ट्यूटोरियल की बदौलत यह तकनीक इस्तेमाल में आसान हो गई और 2020 के दशक में तो डीपफेक और ज्यादा परिष्कृत हो गए, जिनका पता लगाना कठिन हो गया।

असंभव नहीं है डीपफेक कंटेंट की पहचान

डीपफेक मुद्दे पर चिंता बढ़ने का सबसे बड़ा कारण यही है कि क्योंकि इसमें दिखने वाला वीडियो बिल्कुल सही होता है किन्तु एआई के जरिये चेहरा, वातावरण अथवा असली ऑडियो बदल दिया जाता है और देखने वाले को इस बात का जरा भी अहसास नहीं होता कि वह असली नहीं बल्कि डीपफेक वीडियो देख रहा है। डीपफेक में वीडियो और ऑडियो को मशीन लर्निंग और एआई की मदद से बनाया जाता है, जिसमें ‘वॉयस क्लोनिंग’ बेहद खतरनाक हो गई है। डीपफेक कंटेंट की पहचान करने के लिए कुछ विशेष चीजों पर ध्यान देना जरूरी है और अधिकांश डीपफेक को कुछ अतिरिक्त सावधानियों के जरिये पहचाना जा सकता है। तकनीकी विशेषज्ञों के मुताबिक डीपफेक में चेहरे के भाव हमेशा बदलते रहते हैं, ऐसे में चेहरे, गालों और माथे पर ध्यान दें। आंखों, भौहों और पलक झपकने पर भी ध्यान दें और नोटिस करें कि क्या वीडियो में व्यक्ति बहुत कम या बहुत अधिक पलकें तो नहीं झपका रहा है। कुछ डीपफेक ‘लिप सिंकिंग’ पर आधारित होते हैं, इसलिए होठों की हरकत देखें कि वह नेचुरल है या नहीं। वीडियो अथवा फोटो में चेहरे के मस्सों अथवा तिल पर भी ध्यान दें। यह भी देखें के शरीर की परछाई सही जगह पर पड़ रही हैं या नहीं। चश्मे पर भी ध्यान से देखें कि उसमें जो परछाईयां दिखाई दे रही हैं, वे वीडियो के माहौल से मेल खा भी रही हैं या नहीं। ध्यान से देखें कि चेहरे के बाल असली दिख रहे हैं या नहीं। डीपफेक में त्वचा भी बहुत चिकनी या बहुत झुर्रीदार दिखाई दे सकती है। तकनीक के जानकारों के अनुसार, डीपफेक तकनीक से तैयार तस्वीरों और वीडियो को पहचानना आसान तो नहीं होता लेकिन यह असंभव भी नहीं है।

(लेखक 34 वर्षों से पत्रकारिता में निरंतर सक्रिय वरिष्ठ पत्रकार हैं)

टिप्पणियाँ